|

그러나 이 라이브러리는 세상에 존재하지 않는, AI가 만들어낸 환각(거짓 정보 생성)이었다. 더 큰 문제는 해커가 이를 노리고 해당 이름으로 악성 코드를 미리 배포해 두는 경우다. 개발자가 AI의 말을 믿고 내려받는 순간, 시스템은 해커의 손아귀에 넘어간다.

과학기술정보통신부와 한국정보보호산업협회(KISIA) 주관으로 9일 노보텔 앰배서더 서울 강남에서 열린 ‘2025 AI 시큐리티&프라이버시 컨퍼런스’에서 AI가 가져온 새로운 형태의 공급망 위협이 구체적으로 제시됐다. 전문가들은 AI가 코딩의 효율을 높여주지만, 동시에 소프트웨어(SW) 공급망의 가장 약한 고리가 되고 있다고 지적했다.

개발자 95%가 쓰는 AI…거짓 정보로 해킹 통로 열어준다

이만희 한남대 컴퓨터공학과 교수는 이날 첫 세션에서 ‘생성형 AI 시대 공급망 보안 리스크’를 주제로, AI 코딩 도구의 위험성을 지적했다.

이 교수는 앞서 언급한 ‘가짜 라이브러리’ 사례를 들며 “해커가 AI가 환각으로 만들어낼 법한 패키지 이름을 미리 예측해 악성코드를 심어두는 ‘슬랍스쿼팅(Slopsquatting)’ 공격이 현실화하고 있다”고 경고했다. 개발자의 95%가 생성형 AI를 활용할 만큼 의존도가 높아졌지만, 정작 AI 답변에 대한 검증 체계는 전무 하다는 것이다.

위험은 환각뿐만이 아니다. AI가 학습 데이터에 포함된 오래된 보안 취약점을 그대로 답습해 위험한 코드를 생성하는 문제도 심각하다. 이 교수는 직접 생성형 AI에 특정 코딩을 명령하자 AI가 공격에 취약한 코드를 아무런 경고 없이 생성해냈다며, “LLM은 기능적 정확성에만 초점을 두고 대규모 정적 데이터를 학습하다 보니 보안 관점에서 중요한 검사나 접근 통제 로직을 누락할 수 있다”고 지적했다.

또 학습 데이터나 모델 자체를 변조하는 ‘데이터 오염(Poisoning)’ 공격의 위험성도 있다. 이는 공격자가 학습 데이터에 악성 코드를 몰래 섞거나 잘못된 보안 패턴을 정답인 것처럼 라벨링해 AI를 ‘세뇌’ 시키는 방식이다. 이 교수는 “공격자가 백도어를 심은 모델을 고의로 배포하고, 기업이 이를 다운로드할 경우 평소에는 정상 작동하다가도 특정 상황에서 악성 코드를 생성해 제품 전체를 감염시킬 수 있다”고 설명했다.

그는 “프롬프트 단계에서부터 보안 요구사항을 명시하고, 소스코드 분석 도구를 활용하거나 AI 생성 코드를 다른 AI에 검증시키는 습관을 생활화해야 한다”고 강조했다.

모니터 밖으로 나온 로봇…“오작동 막는 ‘행동 제어’ 기술 필수”

AI의 위협은 가상 세계에만 머물지 않는다. AI가 로봇이나 자율주행 기기에 탑재돼 현실 세계로 진출함에 따라 발생하는 ‘피지컬 AI’의 보안 이슈도 대두된다.

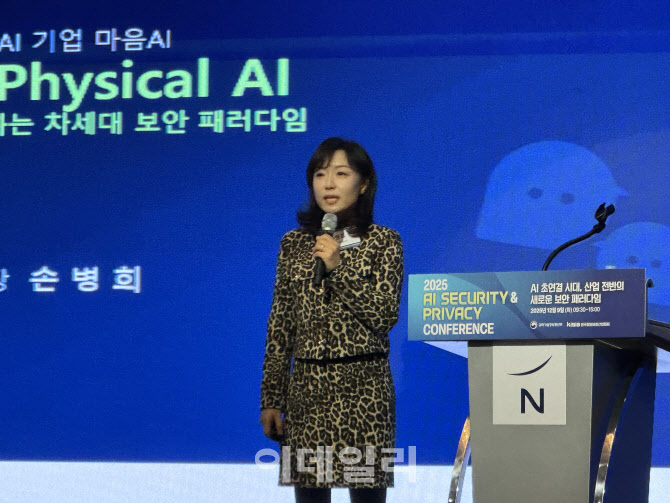

손병희 마음AI 연구소장은 ‘피지컬 AI 보안 동향 및 발전 방향’ 발표를 통해 “피지컬 AI 시대에는 장비가 멋대로 움직이거나 사람에게 돌격하면 큰 사고로 이어질 수 있는 만큼, 현실 세계에서의 보안이 훨씬 더 중요해진다”며 디지털 환경보다 더 강력한 안전장치를 주문했다.

국내 피지컬AI 전문기업 마음AI는 로봇에 AI 칩과 센서를 장착해 활용할 수 있는 범용 피지컬 AI 플랫폼 ‘MAIDE’를 독자 개발했다. 손 소장은 피지컬 AI 보안을 위해 AI 행동을 제어하는 ‘세이프 액트(Safe Act)’와 데이터를 보호하는 ‘시큐어 루프(Secure Loop)’ 등 자사 핵심 기술을 소개했다.

손 소장은 특히 국방 분야를 예로 들며 물리적 제어의 중요성을 강조했다. 그는 “전쟁 무기로 쓰이는 로봇 개가 통제권을 벗어나거나 적에게 탈취될 경우, 아군을 공격하지 않도록 기체를 스스로 폭파하는 ‘킬 코드(Kill Code)’를 탑재하기도 한다”며 상황에 따라 비정상적인 행동을 즉각 차단하고 복구하는 기술이 필수적이라고 설명했다.

아울러 데이터 보안 측면에서도 “가정용 로봇이나 키오스크가 수집하는 민감한 음성·영상 정보가 유출되지 않도록, 기획 및 설계 단계부터 프라이버시 보호 기술을 내재화해야 한다”고 조언했다.

|

이날 기조연설을 맡은 김범수 연세대 정보대학원 교수는 AI로 인해 고도화되는 위협에 비해 국내 기업들의 대응 태세는 여전히 미흡하다고 진단했다.

김 교수는 “2024년 이후 보안 사고가 매일 터질 정도로 급증했고, 올해는 신고된 건수만 1000건이 넘어 하루 평균 2~3건꼴로 사고가 발생하고 있다”고 밝혔다. 그는 특히 미국은 금전적 피해 중심의 랜섬웨어 사고가 잦은 반면, 한국은 디지털화된 환경 탓에 대형 개인정보 유출 사고 비중이 높다고 분석했다.

김 교수는 현재 기업들의 보안 수준을 계절에 맞지 않는 옷차림에 비유했다. 그는 “최근 사고가 잦은 건 기업들이 보안을 아예 안 해서가 아니라, 한겨울의 추위(고도화된 공격)가 닥쳤는데 여전히 여름 옷(과거 수준의 보안)을 입고 있기 때문”이라며 “기업 규모와 환경에 맞는 적절한 ‘보안 옷’을 맞춰 입어야 한다”고 꼬집었다.

이를 위해 김 교수는 △미래 위협(양자·우주·피지컬AI)에 대비한 R&D 강화 △기술과 정책을 아우르는 통합 거버넌스 구축 △경영진의 인식 전환 등을 제언하며 “보안은 비용이 아니라 AI 시대의 브랜드 경쟁력”이라고 역설했다.

.png)

.png)

!['280만원 전망' 아이폰 폴더블, 핵심 기능 5가지 빠지나[모닝폰]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/04/PS26042700108t.jpg)