그러나 여전히 갈등의 소지가 있습니다. 핵심 쟁점 중 하나는 ‘고위험 AI’에 대한 규율을 어떻게 할 것인가에 대한 문제입니다. 어제(16일) 권칠승 의원이 주최한 ‘AI 기본법’ 공청회에서도 이 문제를 두고 논란이 있었습니다. 권 의원이 대표 발의한 법안에서는 ‘고위험 AI’의 의무 위반에 대해 벌칙을 규정하고 있는데, 이에 대해 찬반 의견이 엇갈렸습니다.

찬성하는 쪽에서는 AI가 악의적으로 사용될 경우에 대비한 규율이 반드시 필요하다는 입장입니다. 반면, 저는 다음과 같은 이유로 반대합니다:

①죄형법정주의 위반(규제의 명확성 원칙 위배) ②AI 생산국에 가까운 국내 산업의 현실(위험기반 규제를 도입하려는 EU는 AI 소비국)③대학생 등의 AI 스타트업 창업 위축 가능성 때문입니다.

이날 토론회에서도 권 의원을 비롯한 패널들 대부분이 ‘고위험 AI’ 도입에 대해 반대하거나 신중한 논의가 필요하다는 입장을 밝혔습니다.

|

①죄형법정주의 위반(규제의 명확성 원칙 위배)

권칠승 의원이 발의한 AI 기본법안에 따르면, 고위험 AI에 대한 검·인증을 받지 않고 AI 서비스를 제공할 경우 3년 이하의 징역 또는 3000만 원 이하의 벌금에 처하도록 규정하고 있습니다.

이에 대해 윤계형 한국법제연구원 연구위원은 “고위험 AI를 국민의 생명과 신체, 건강과 안전, 기본권의 보호, 국가 안보 및 공공 복리에 중대한 영향을 미칠 우려가 있는 위험성이 높은 AI로 정의하면서도, 법률이 아닌 하위 법령(대통령령)에 기준을 위임한 것은 기술 발전에 따른 유연성을 고려한 조치”라고 평가했습니다.

하지만, ‘무엇을 고위험 AI로 볼 것인가’에 대한 기준을 시행령에 담는다고 해도, 이는 죄형법정주의 원칙에 위배될 수 있다는 우려가 제기됩니다. 대법원 법원행정처 김택우 판사는 “‘중대한 영향’, ‘위험성이 높은’, ‘대통령령이 정하는 기준’과 같은 포괄적인 용어로 규정하면 허용되는 AI의 한계가 불명확해지고, 그로 인해 기술 발전에 제약이 생길 우려가 있다”며 “AI의 위험성은 기술 자체가 아니라 활용 방식에 따라 다르게 평가돼야 한다”고 언급했습니다.

|

②AI 소비국인 유럽도 구체적인 규제 유예(국내 AI산업의 현실)

글로벌 시장에서 위험 기반 AI 규제 법체계를 구축한 곳은 유럽연합(EU)이 유일합니다. EU의 AI법은 사전 규제를 특징으로, 위험 정도에 따라 허용 불가 위험, 고위험, 제한된 위험, 저위험 또는 최소 위험으로 구분하여 규제합니다. 이 법은 사전 규제와 사후 규제를 모두 포함합니다. 예를 들어, CCTV 안면 인식의 실시간 사용 금지는 올해 12월부터 적용되며, 일반 목적 인공지능 모델의 보고 의무는 내년 5월부터 시행됩니다.

그러나 이러한 규제가 지나치게 엄격하다는 비판이 제기되고 있습니다. 고위험 AI 제공 시 몇 달 치 로그를 남겨야 하는지, 단순 코딩은 제외된다고 하지만 정의가 모호하다는 지적이 있습니다. 또한, 법 위반 시 최대 매출액의 7% 또는 3500만 유로(약 518억 원)의 과징금을 부과받게 됩니다.

이러한 이유로 애플은 아이폰16에 오픈AI를 탑재하려던 계획을 EU에서는 철회한 상황입니다.

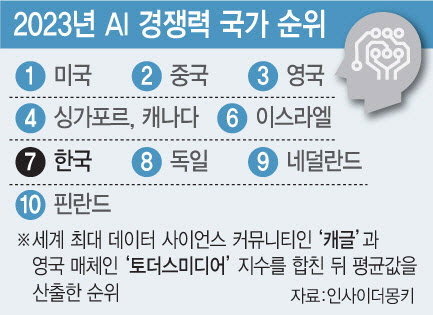

과학기술정보통신부 남철기 인공지능기반정책과장은 “우리나라는 독자적으로 파운데이션 모델, 클라우드, AI반도체를 개발하는 AI 생산국에 가깝지만, EU는 AI 소비국에 가깝다”고 설명했습니다. 그는 이어 “강력한 AI 법을 제정한 EU도 고위험 AI 규제의 시행을 2~3년 후로 정한 만큼, 우리나라도 단계적 보완 입법을 통해 글로벌 규범 정합성에 부합해야 한다”고 당장 고위험 AI에 대한 규제 도입에 부정적인 입장을 밝혔습니다.

③대학생 등 AI 스타트업 창업 위축 가능성

가장 큰 문제는 여기에 있습니다. 스타트업에 대한 투자가 얼어붙은 상황에서 유일하게 투자가 이뤄지는 곳이 AI 분야입니다. 클라우드사와 통신사 등이 AI 스타트업 지원에 나서고 있으며, 정부도 생성 AI 모델 보유 기업 주도의 산학 협력 프로젝트를 통해 핵심 인재를 양성하는 생성 AI 선도 인재 양성 과정을 신설하는 등 AI 인재 양성에 힘쓰고 있습니다.

그러나 규제의 명확성이 담보되지 않은 ‘고위험 AI’에 대한 규제와 신체형(징역 3년 이하)은 청년들에게 낙인 효과를 줄 수 있습니다.

정종구 서울대 컴퓨터공학부 강사(변호사)는 “고위험 AI 관련 의무 위반에 대해 형사처벌 규정을 두는 것은 비범죄화 기조에 부합하지 않는다”면서 “차라리 매출액 기준 일정 비율을 과징금으로 부과하는 방식이 보다 적절하지 않을까”라고 말했습니다.

윤병성 한국과학기술정보연구원 정책연구실 박사는 “법안에 고위험 AI를 검·인증 받지 않고 제품이나 서비스를 개발하면 징역형까지 받게 되는 부분은 기업이 사업하는 데 어려움이 있을 것으로 생각된다”고 언급했고, 김성철 생성 AI 스타트업 협회 사무국장은 “똑같은 딥페이크 기술이라고 해도 누군가는 음란물을 만들 수도 있지만, 누군가는 교육 등 좋은 목적으로 사용할 수도 있다. 규제를 다 걸어버리면 스타트업의 기회가 줄어들 수 있다”고 걱정했습니다.

.png)

.png)

![서울시장 후보 사는 집은…오세훈 ‘대치'vs정원오 ‘왕십리'[누구집]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/04/PS26042600079t.jpg)

![매출 누락·가짜 영수증에 10억 토해낸 사연…“절세 아닌 범죄”[세상만사]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/04/PS26042600144t.jpg)

![아들 여자친구 살해한 엄마…경찰은 30분이나 늦었다 [그해 오늘]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/04/PS26042600001t.jpg)