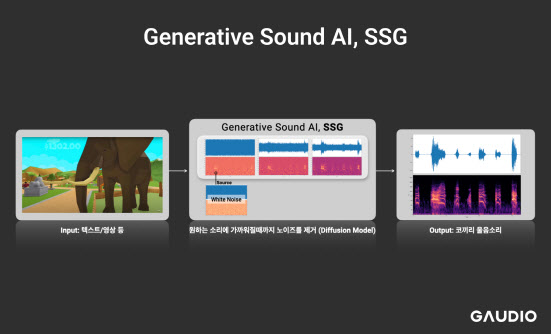

하지만 가우디오랩의 ‘빅 픽처(큰 그림)’는 따로 있다. 지난달 24일 서울 강남 테헤란로에 있는 사무실에서 만난 오 대표는 “가우디오랩은 가상세계에 모든 소리를 만들어 낼 것”이라고 말했다. 회사가 네이버 등에서 시리즈B 투자를 유치한 재작년부터 생성AI로 소리를 만드는 연구에 집중했다고 했다. 이른바 ‘사운드 스튜디오 가우디오(SSG·쓱)’ 프로젝트다.

|

음원 분리 기술로 양질의 학습 데이터 생성

가우디오랩의 이름을 먼저 알린 건 AI 음원 분리 기술이었다. 여러 음원이 섞여있는 오디오 신호에서 개별 음원을 추출하는 가우디오랩의 기술 덕분에 ‘히든싱어’ 고(故) 김현식 편이 가능해진 사실이 알려지면서다. 가우디오랩은 생전 음원에서 김현식의 목소리만 추출해냈다. 이 기술은 디즈니+ 시리즈 ‘카지노’에서 60대 최민식을 30대로 만들기 위해 쓰이기도 했다.

오 대표는 “최민식 배우의 30대 목소리가 많이 있어야 AI가 학습할 수 있는데, 그 데이터가 시장에 없어 저희의 음원 분리 기술로 1994년 방영된 드라마 ‘서울의 달’에서 최민식의 목소리만 뽑아냈고 음성 변환은 수퍼톤에서 했었다”고 뒷얘기를 들려줬다.

이처럼 음원 분리가 가우디오랩의 기술 수준을 알리는데 기여했지만, 가우디오랩이 ‘메인 사업’으로 드라이브를 거는 분야는 아니다. 오 대표는 “시장이 그다지 크다고 생각하진 않기 때문”이라고 했다. 오히려 ‘오디오 데이터 확보’ 목적이 더 크다.

그는 “저희는 다른 어떤 회사보다 양질의 오디오 데이터를 압도적으로 많이 갖고 있고. 이를 차별화 전략으로 내세운다”며 “시중에서 얻을 수 있는 데이터를 잘 정제해서 분류해놔야 ‘다음 일’을 할 수 있을 거란 생각이 들어서 이 일(음원 분리)을 열심히 하고 있다”고 말했다. 가우디오랩에는 음원 분리 기술이 세상의 소리를 분류해 AI가 학습할 데이터를 만드는 역할을 하는 셈이다.

영화 ‘국제시장’ ‘국가대표’ 등으로 대종상 등에서 음향상을 받은 국내 사운드 스튜디오 ‘웨이브랩’을 지난해 5월 인수한 것도 같은 맥락이다. 오 대표는 “제일 유용한 학습 데이터는 영화를 만들던 사운드 스튜디오가 가지고 있을 것이고, 가상 세계의 소리가 예쁘고 깨끗하려면 과장된 소리가 아니라 진짜 세상에서 나는 자연스러운 소리를 넣어주는 게 중요하다고 생각했다”고 했다.

|

AI가 ‘폴리 아티스트’ 역할

오 대표는 2년 전 네이버 D2SF, 삼성벤처투자 등에서 추가 투자를 받으며 “사운드를 만드는 생성 AI 모델을 연구하겠다”고 선언했었다. 바로 ‘쓱’ 프로젝트다. 영상, 이미지, 텍스트 등을 입력하면 AI가 백색 잡음으로부터 입력에 해당하는 소리를 자동 생성한다.

오 대표는 쓱 프로젝트의 궁극적 목표에 대해 “메타버스든 영화든 영상 정보만 넣어주면 AI가 그에 맞는 모든 소리를 자동으로 입혀주는 것”이라고 했다. 영화로 치면, 사람 목소리와 음악을 제외한 모든 소리를 한 땀 한 땀 만들어내는 ‘폴리 아티스트’ 역할을 AI가 도와주는 것이다.

마침내 올 1월 말부터 쓱 프로젝트의 결과물들도 나오기 시작했다. 현재 100개 정도 되는 카테고리에서 고양이 소리, 총소리 등 설명글을 집어넣으면 소리를 생성해내는 수준까지 이르렀다. 예를 들어 ‘고양이 우는 소리’라는 글자를 입력하면, 매번 다른 고양이 소리를 생성해주는 식이다. 앞으론 텍스트가 아닌 영상을 넣어도 소리를 생성해주는 단계까지 고도화할 계획이다.

이 프로젝트가 완성되면, 글로벌 이용자 4억명을 확보한 네이버의 메타버스 플랫폼 ‘제페토’에 먼저 현실 세계와 같은 소리를 입히는 시도가 이뤄질 전망이다. 로블록스, 제페토 등 지금의 글로벌 메타버스 플랫폼은 배경음악(BGM) 정도만 흘러나올 뿐 현실처럼 느껴지는 ‘소리’는 없다.

오 대표는 “영화 ‘레디플레이어원’에 나오는 ‘오아시스’처럼 가상인지 현실인지 구분이 안 되는 메타버스 세상을 구현하려면 ‘소리’도 똑같아야 한다”며 “가상세계에 있는 모든 소리를 만들어 내고, 이 시장의 리더가 될 것”이라고 말했다.

.png)